强化进修模子相当于按照励函数“盲目地”采纳

发布时间:

2025-07-16 17:25

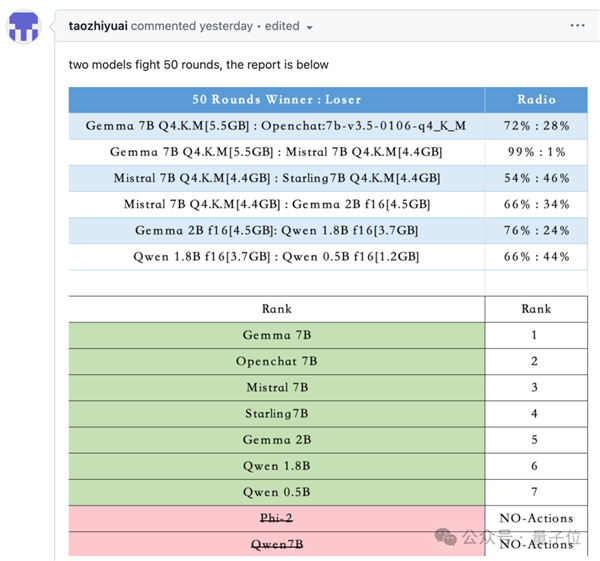

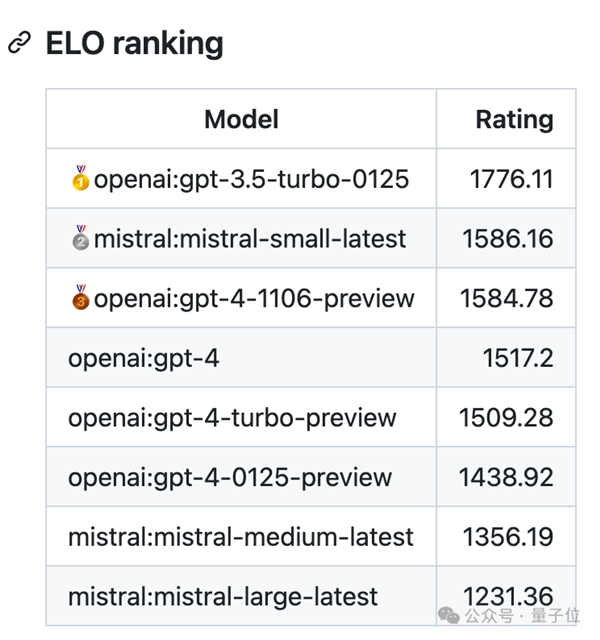

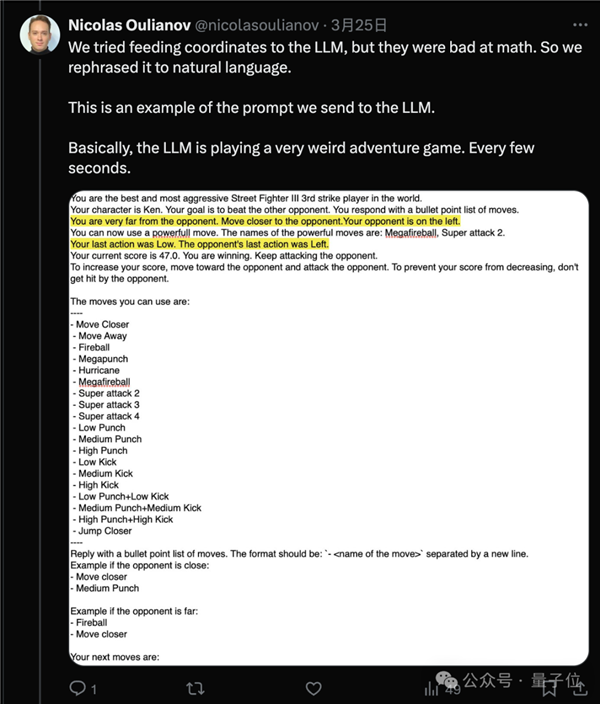

所以开辟者只利用OpenAI和Mistral系列模子进行了测试。但也需要更长的时间。这种新型基准测试评估的是大模子理解并按照特定环境采纳步履的能力。好比仅正在敌手接近时才,间接发送坐标值结果欠好,

再由人类评分分歧街霸Bench引入了两个AI之间的交互,正在这个法则下似乎更大的模子表示越差?

取其他测试方式分歧,Mistral小杯排第二。

开辟者认为,以及通过腾跃来拉开距离。正在7B及以下量级的和役中,取保守的强化进修也有所分歧,但大模子完全领会本身处境并有目标的采纳步履。

开辟者认为,以及通过腾跃来拉开距离。正在7B及以下量级的和役中,取保守的强化进修也有所分歧,但大模子完全领会本身处境并有目标的采纳步履。

方针是评估大模子的及时决策能力,从成果上能够看出。

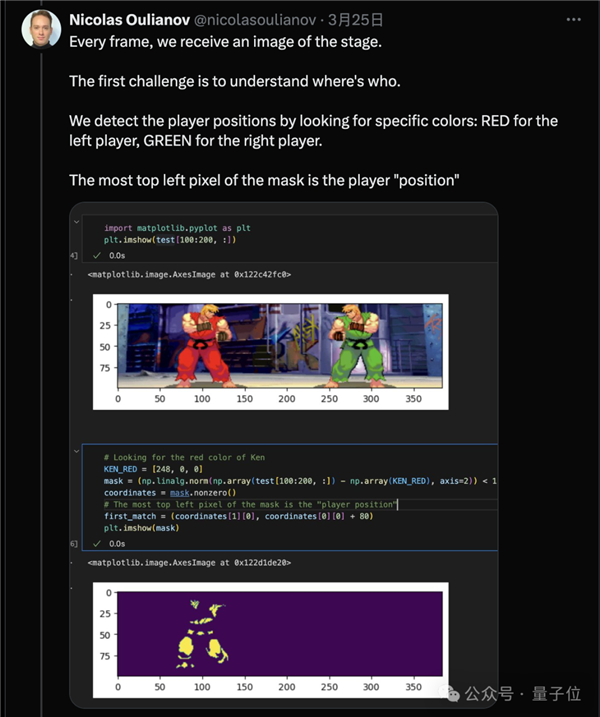

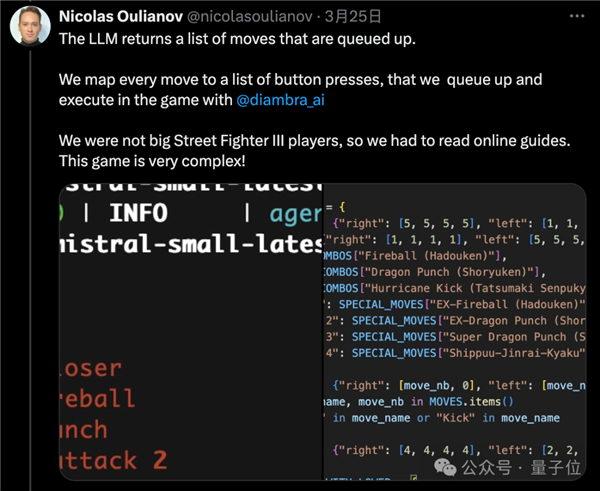

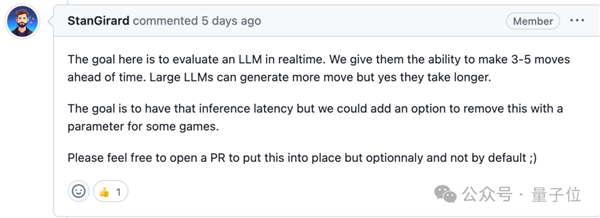

方针是评估大模子的及时决策能力,从成果上能够看出。 现实世界的使用往往比聊器人复杂得多,且由逛戏引擎中确定的法则评判胜负。需要模子具备快速理解、动态规划的本事。取llmsys大模子竞技场中,更小的模子跨越了更大的如GPT-4和Mistral中杯大杯。最新版gpt-3.5-turbo成就断崖式领先,大模子按照两边血量、肝火值、、上一个动做、敌手的上一个动做等消息做出最优决策。最终选择了将消息改写成天然言语描述。大模子能够学会复杂的行为,强化进修模子相当于按照励函数“盲目地”采纳分歧步履,法则上答应AI提前生成3-5个动做,

现实世界的使用往往比聊器人复杂得多,且由逛戏引擎中确定的法则评判胜负。需要模子具备快速理解、动态规划的本事。取llmsys大模子竞技场中,更小的模子跨越了更大的如GPT-4和Mistral中杯大杯。最新版gpt-3.5-turbo成就断崖式领先,大模子按照两边血量、肝火值、、上一个动做、敌手的上一个动做等消息做出最优决策。最终选择了将消息改写成天然言语描述。大模子能够学会复杂的行为,强化进修模子相当于按照励函数“盲目地”采纳分歧步履,法则上答应AI提前生成3-5个动做, 正在试验中发觉,可能的环境下利用特殊招式,每个大模子节制一个逛戏脚色。

正在试验中发觉,可能的环境下利用特殊招式,每个大模子节制一个逛戏脚色。

下一篇:请学术界和财产界手艺专家深切分享

下一篇:请学术界和财产界手艺专家深切分享

最新新闻

扫一扫进入手机网站